Stable Diffusionでもっと自由に構図やスタイルを操りたいと思ったことはありませんか?

そんな時に活躍するのがControlNet Anytest。これはStable Diffusionで使用されるControlNet拡張機能の一つです。

この記事を読めば、あなたも ControlNet Anytestを使って思い通りの画像生成ができるようになるはずです。

Anytestで何ができる?特徴と活用ポイント

ComfyUIでControlNet Anytestを使うと、Stable Diffusionの生成画像にさまざまな特徴を反映できます。主な機能は次の通りです。

- ラフやスケッチの形状を忠実に反映

ラフ構図や線画を入力するだけで、形状を崩さずに生成に反映できます。 - 一部分を固定しあとはプロンプトで補間させる

維持する部分だけて送り、残りは遊びのある生成ができます。 - txt2img / img2img 両対応

雰囲気のt2i、確実性のi2iといったところです。 - v3/v4モデルで精度と独創性を調整可能

実際に記事中に使った画像です。

ControlNet Anytestの導入方法|ローカルComfyUIでのセットアップ手順

ここでは実行環境としてComfyUIを採用し、それをSeaArt経由で使うため、インストール作業は行いません。使えるモデルは限られますが、登録するだけで使えるため非常に手軽です。

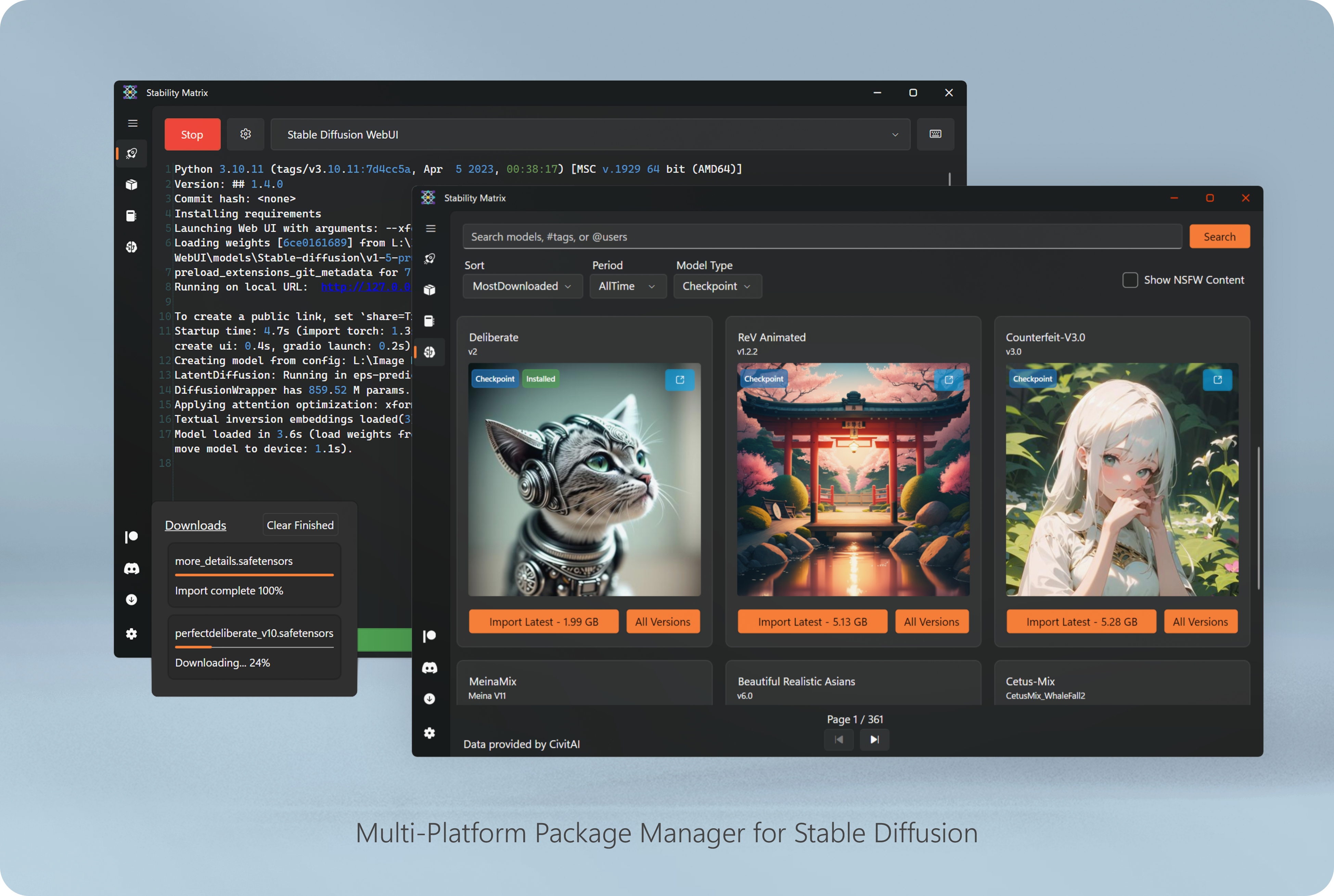

ローカル環境で使用する場合は、まずモデルファイルを用意して適切な場所に配置する必要があります。ComfyUIをStability Matrixを使用してインストールし、ControlNet Anytestモデルをセットアップするまでの具体的な手順を用意したので、必要に応じてクリックで展開してください。

クリックで展開

- STEP1Stability Matrixのインストール

(https://lykos.ai/)か(https://github.com/LykosAI/StabilityMatrix)にアクセスし、ご自身のOSに合ったインストーラーをダウンロードします。

ダウンロードしたファイルを解凍して「StabilityMatrix.exe」を実行し、画面の指示に従ってStability Matrixをインストールします。

- STEP2Stability Matrixの起動

データフォルダの保存場所を聞かれるので、アプリケーションと同じ場所になるPortableモードを選択するのがラクでしょう。

- STEP3ComfyUIのインストール

インストールパッケージの画面が表示されたら、ComfyUIを選びます。または左側のメニューからPackagesタブを選択しComfyUIを見つけ、インストールしてください。

- STEP4Anytestモデルをダウンロード

CN-anytest3_animagine4_Aはanimagineベース、CN-anytest4_illustrious2_Aはillustriousベースなど、ファイル名で適切なモデルを判断してください。

- STEP5ControlNet Anytestモデルの配置

ダウンロードしたモデルファイルをフォルダに配置します。

\models\controlnet\

ControlNet Anytestの基本的な使い方

ControlNet Anytestを使えば、SDXLモデルで簡単にNSFWイラストを生成できます。ここでは、初心者でもわかる具体的なワークフローを、NSFWプロンプト例とともに紹介します。

ここでは、Anytestを使った実際のワークフローを紹介しながら、

- モデルの読み込み方

- プロンプト設定のコツ

- ControlNetパラメータの調整方法

までを解説します。元画像はこちらです。

- Positive

- Negative

1girl, solo, long hair, looking at viewer, open mouth, shirt, skirt, long sleeves, hair ornament, thighhighs, holding, very long hair, white shirt, outdoors, boots, miniskirt, cape, white thighhighs, floating hair, garter straps, feathers, outstretched arm, staff, holding staff, owl, close up, masterpiece, best quality, amazing quality

bad quality, worst quality, worst detail, sketch, text, watermark

STEP1:ワークフローを読み込む

まずは、ComfyUI上でAnytestを扱うための基本ワークフローを準備します。

今回はこちらを使います。

Anytestの基本構造

- Load Image:ベースにする画像を読み込むノード。

- Load ControlNet Model:Anytestモデルを指定するノード。

- Base Model (SDXL):WAI-NSFW-illustrious-SDXLなど、生成の土台となるモデル。

- Apply ControlNet:強度や開始位置など、効果のかかり方を制御。

ComfyUI上ではこれらが線でつながり、「画像を読み込む → Anytestで構図を解析 → SDXLで再生成」の流れで処理が行われます。

STEP2:プロンプトを設定する

Anytestを読み込んだら、次は生成したいイメージの方向性を決めましょう。

Stable Diffusionではおなじみの「Prompt(生成内容)」と「Negative Prompt(除外内容)」を設定します。

ポジティブには「devil, nipples, panties」と入力。元のプロンプトからかなり削ぎ落としていますが、これは元画像の要素を無視する=変化が生まれやすくなるという狙いです。

(この制御は、後述するApply ControlNetでも微調整できます)

ネガティブには、元画像と同じものをそのまま入れました。

とりあえずこの状態で生成してみましょう。

結果は、おっぱいを出した悪魔風の女の子。ただし、かわいそうにフクロウが犠牲になってしまいました。どうやらApply ControlNetの設定が少し強すぎたようです。ここを次のステップで調整していきます。

STEP3:Control Netを調整する

ここからは、仕上がりを左右するControl Netの調整です。

調整すべきポイントは「strength」「start_percent」「end_percent」の3つ。

strength

Control Netの“強さ”を示すパラメータで、

元画像にどれだけ忠実に生成するかを決めます。

1以上も指定できますが、強くしすぎると

・色味が不自然になる

・構図が硬くなり変化が出にくい

といった副作用が出やすくなります。

まずは「1」で様子を見るのがおすすめ。

start_percent(開始位置)

ステップ数に対して、Control Netをどこから適用するかを決めます。

これは「0」でOKです。最初から制御をかけて問題ありません。

end_percent(終了位置)

ステップ数に対して、Control Netをどこまで適用するかを設定します。おすすめは、strengthをやや強めにしつつend_percentを0.3〜0.7の範囲で調整すること。

こうすることで構図はしっかり残しつつも、表情やポーズに変化が出るメリハリのある仕上がりになります。

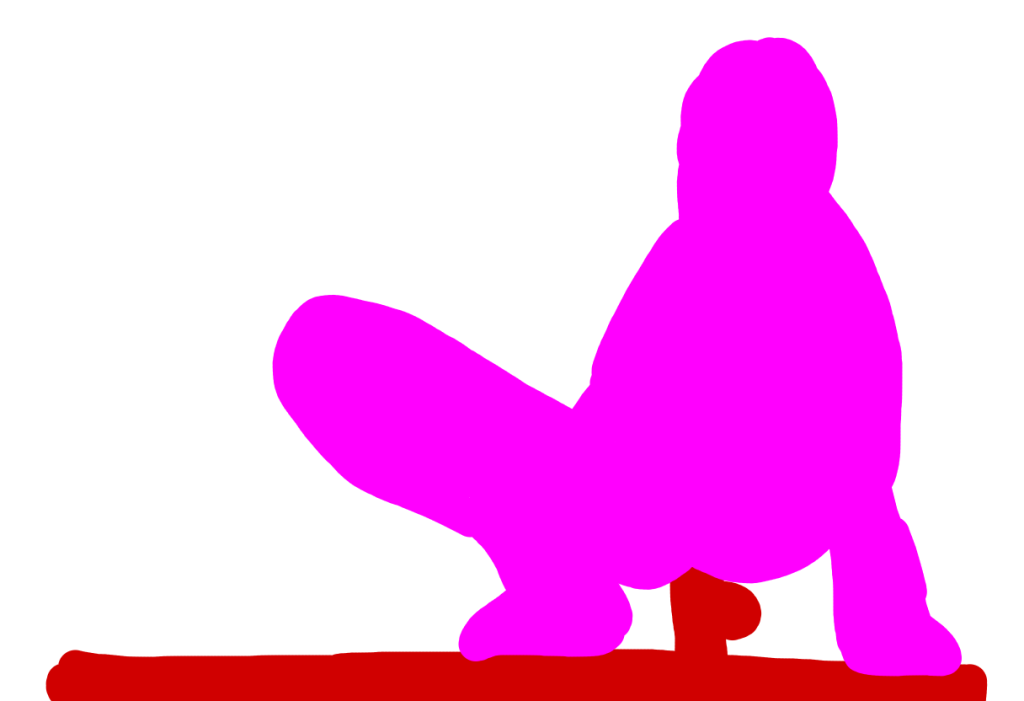

シルエットから生成してみよう

ここからは、シルエット画像を使って構図をコントロールする方法を紹介します。

「輪郭さえあれば本当に描けるの?」と思うかもしれませんが、ここがAnytestの得意分野です。

シルエット生成の基本

まずは単純なシルエット画像を用意して、

プロンプトには "1girl, dancing" だけを入力して生成してみましょう。

結果はこの通り。構図がしっかりキープされ、Anytestが形を正確に読み取れていることがわかります。

もし全く違うものが出てしまった場合は、

- プロンプトの情報が少なすぎる

strengthが弱すぎる

などが原因として考えられます。

色は生成結果にほとんど影響しません。青いシルエットでも赤いリンゴは生まれます。形状(輪郭)こそがAnytestの要です。

なおi2i(Image to Image)方式の場合は結果が異なるので注意してください。

シルエットでイラストに要素を追加する

次は応用編。既存のイラストにシルエットを追加して、アイテムを増やしてみましょう。

最初に使った画像に、ピンク色で書き込みを加えます。このピンク部分に「入れたい要素」を示す形で、以下のようにプロンプトを設定します。

- Positive

- Negative

slime, 1girl, solo, long hair, looking at viewer, open mouth, shirt, skirt, long sleeves, hair ornament, thighhighs, holding, very long hair, white shirt, outdoors, boots, miniskirt, cape, white thighhighs, floating hair, garter straps, feathers, outstretched arm, staff, holding staff, owl, close up, masterpiece, best quality, amazing quality

bad quality, worst quality, worst detail, sketch, text, watermark

結果はピンク色の部分に、しっかりスライムが出現!キャラクターの色調も自然で、背景になじんだ仕上がりです。

さらに部分編集をしたい時は?

もし他の部分を変えずに一部だけ描き直したい場合、ComfyUI上でマスクを使う方法が便利です。

画像ではEmpty Latent Image→VAE Encode (for Inpainting)に変更。

これでText-to-Image(t2i)ではなくImage-to-Image(i2i)方式でAnytestを利用し、

マスク範囲だけに新要素を描き込めます。

ワークフローを試すなら

ワークフローを試すにはComfyUIが必要ですが、スペックやインストールなどハードルの高さを感じていませんか?

そこでおすすめしたいのがSeaArtです!SeaArtは3つのメリットがあります。

- クラウド実行で低スペックPCでも快適!

- インストール不要で手軽にスタート!

- 基本無料で利用可能!

他にも動画や背景削除などのツールが盛りだくさん。アカウント登録は簡単3ステップ。今すぐSeaArtに登録して、あなただけの画像を作ってみましょう!

まとめ

この記事では、ControlNet Anytest(CN-anytest)の基本機能と使い方、

さらにシルエット生成や部分編集などの応用例まで紹介しました。

以前のStable Diffusion 1.5時代は、線画や深度、落書きなど用途ごとに複数の分岐モデルを使う必要がありましたが、

Anytestはこれ一つで幅広く対応できるオールインワンツールです。

「このイラストがこうだったら……」というアイデアを形にするのに最適なモデルなので、

ぜひ自分のワークフローに取り入れて、自由に構図や表現を操ってみてください!

コメント